Apple หลังยุค iPhone จะทำ Visual Intelligence อุปกรณ์สวมใส่มี AI ให้พกพาไปได้ทุกที่

“Summary“

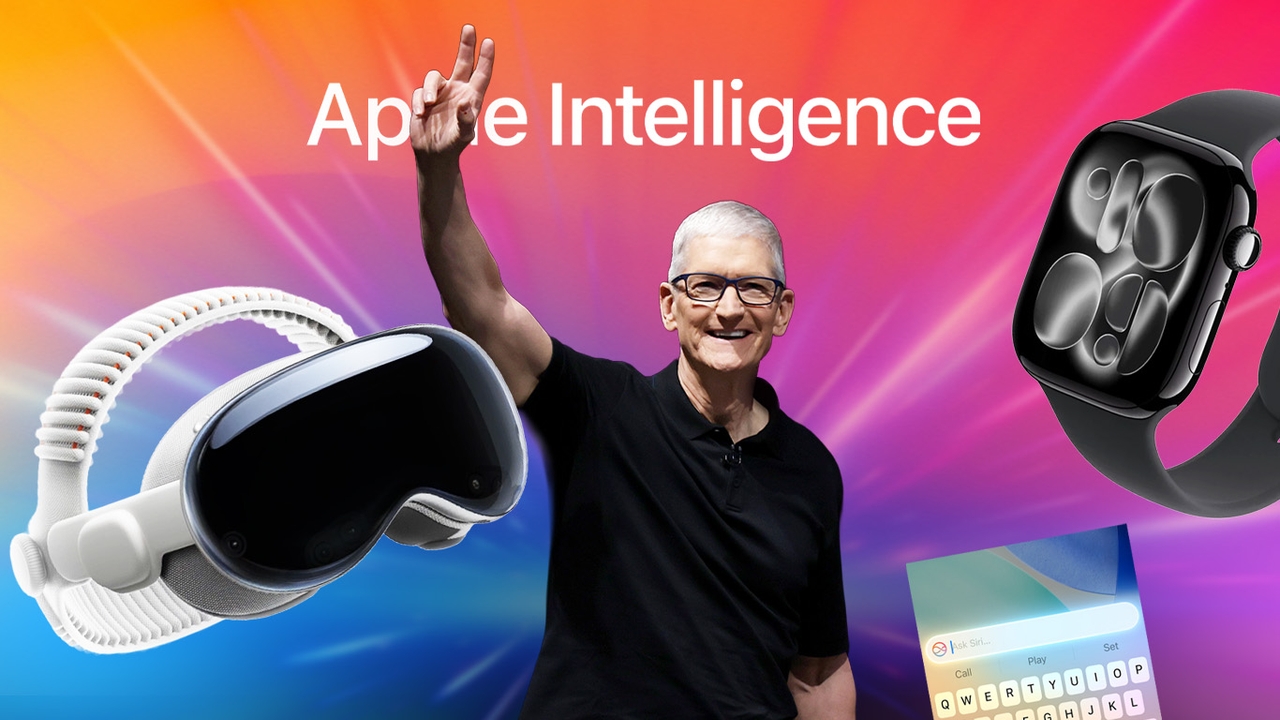

Apple ส่งสัญญาณชัด เป้าหมายต่อไป พัฒนา AI Wearables อุปกรณ์สวมใส่ที่ขับเคลื่อนด้วย AI ชูโรงเป็นผลิตภัณฑ์ชี้ชะตา ลงแข่งในสนามใหญ่ เชื่อมั่นในระบบนิเวศและฐานผู้ใช้ของตัวเองที่จะเอาชนะคู่แข่งได้

Latest

Tim Cook ซีอีโอของ Apple ส่งสัญญาณชัด บริษัทกำลังผลักดันการพัฒนาอุปกรณ์ AI (AI Devices) โดยระบุในงานประชุมใหญ่กับพนักงานเมื่อต้นเดือนกุมภาพันธ์ที่ผ่านมาว่า “Apple กำลังพัฒนาผลิตภัณฑ์กลุ่มใหม่ที่จะขับเคลื่อนด้วย AI” และ “เราตื่นเต้นมากกับสิ่งนี้” พร้อมกับเสริมว่า บริษัทกำลังเดินหน้าลงทุนในเทคโนโลยีใหม่ ๆ เพราะ “โลกกำลังเปลี่ยนแปลงอย่างรวดเร็ว”

วางให้ “Visual Intelligence” เป็นฟีเจอร์ชี้ชะตาใหม่ของ Apple ในตลาดอุปกรณ์สวมใส่หลังบริษัทเทคโนโลยียักษ์ใหญ่อย่าง Meta มีแว่นตาอัจฉริยะที่กำลังครองตลาด และ OpenAI เองก็กำลังเร่งพัฒนาอุปกรณ์สวมใส่ด้วยเช่นกัน

จาก Apple Watch มา Vision Pro สู่ AI Wearables และ Visual Intelligence

ย้อนกลับไปปี 2013 ก่อนการเปิดตัว Apple Watch หลายปี Tim Cook เคยกล่าวว่า “วงการเซนเซอร์กำลังร้อนแรง” ซึ่งในเวลานั้น Apple กำลังพัฒนานาฬิกาอัจฉริยะที่ตั้งเป้าเป็นเหมือนห้องแล็บทางการแพทย์บนข้อมือ ทั้งวัดอัตราการเต้นหัวใจ ความดันโลหิต และระดับน้ำตาลในเลือด พร้อมดึงตัวผู้เชี่ยวชาญจากอุตสาหกรรมเซนเซอร์การแพทย์เข้ามาร่วมงานอย่างจริงจัง

และเมื่อ Apple Watch เปิดตัว นาฬิกาอัจฉริยะนี้ยังไม่ได้กลายอุปกรณ์การแพทย์เต็มรูปแบบ แต่ Apple ค่อย ๆ เติมเซนเซอร์ใหม่เข้าไปอย่างต่อเนื่อง จนปัจจุบัน สามารถเพิ่มฟีเจอร์ตรวจจับความดันโลหิตสูงและแจ้งเตือนภาวะหยุดหายใจขณะหลับ อีกทั้งยังมีทีมลับในฝ่ายซิลิคอนที่กำลังพัฒนาเซนเซอร์วัดระดับน้ำตาลในเลือดแบบไม่ต้องเจาะผิวหนังอีกด้วย

หลังจาก Apple Watch แล้ว Apple ได้บุกตลาดใหม่อีกครั้งด้วยเฮดเซตผสมโลกจริงกับโลกเสมือน โดย Tim Cook ก็ได้หลุดคำใบ้ออกมา พูดถึงศักยภาพของ AR และ VR อย่างต่อเนื่อง จนท้ายที่สุดถูกรวมเป็นผลิตภัณฑ์เดียว และเกิดมาเป็น Apple Vision Pro

ในปี 2016 ทาง Tim Cook เคยบอกว่า AR จะสำคัญพอ ๆ กับการกินข้าววันละสามมื้อ และ Apple ใช้เงินหลายพันล้านดอลลาร์สหรัฐพัฒนา Vision Pro ก่อนเปิดตัวในปี 2023 และวางขายในปี 2024 แม้ยอดขายยังไม่ถึงขั้นฮิตถล่มทลาย แต่สะท้อนชัดเจนว่า Apple ต้องการจะครองพื้นที่ในตลาดนี้ด้วย

และล่าสุดตามบทความของ Mark Gurman บน Bloomberg ระบุว่า Tim Cook เริ่มพูดถึงหมวดหมู่สินค้าใหม่แล้ว โดยจะเป็นอุปกรณ์สวมใส่ AI ซึ่งจะขับเคลื่อนด้วยเทคโนโลยีที่ Apple เรียกว่า “Visual Intelligence”

โดย Visual Intelligence เปิดตัวครั้งแรกบน iPhone 16 Pro ในปี 2024 ภายใต้แบรนด์ Apple Intelligence ก่อนจะขยายไปสู่อุปกรณ์อื่น โดยผู้ใช้สามารถถ่ายภาพหรือสกรีนช็อต แล้วไปถามคำถามเกี่ยวกับภาพนั้นผ่าน ChatGPT หรือค้นหารูปภาพผ่าน Google ได้ทันที

แต่ Apple ไม่ได้ตั้งใจพึ่งพาเทคโนโลยีของค่ายอื่นตลอดไป บริษัทกำลังพัฒนาโมเดลด้านของตัวเอง และเตรียมให้เทคโนโลยีนี้เป็นศูนย์กลางของอุปกรณ์ AI รุ่นใหม่ ไม่ว่าจะเป็น AirPods รุ่นอัปเกรด แว่นตาอัจฉริยะ หรือแม้แต่ Pendant ที่เป็นเหมือนจี้ห้อยคอมีกล้องคอมพิวเตอร์วิชันและเซนเซอร์ติดตัว (ก่อนหน้านี้มีรายงานว่า Apple เคยพัฒนานาฬิกาที่มีกล้องเพื่อจุดประสงค์เดียวกัน แต่โครงการถูกพักไป)

Visual Intelligence ทำอะไรได้บ้าง?

สำหรับ Visual Intelligence มีการใช้งานพื้นฐาน อย่างเช่น ถ่ายภาพจานอาหารเพื่อให้ระบบระบุชนิดและส่วนผสม ฟีเจอร์จะเป็นขั้นสูงขึ้น โดยอุปกรณ์อาจให้คำแนะนำแบบเจาะจงตามสิ่งที่เห็น เช่น บอกให้เดินผ่าน “อาคารสีแดงด้านหน้า” แทนที่จะบอกเพียงระยะทางเป็นฟุต หรือเตือนให้ทำบางสิ่งเมื่อเดินเข้าใกล้วัตถุหรือสถานที่ที่กำหนด

ในช่วงรายงานผลประกอบการไตรมาสล่าสุด Tim Cook เคยยกให้ Visual Intelligence เป็นหนึ่งในฟีเจอร์ยอดนิยมที่ช่วยให้ผู้ใช้ค้นหา ตอบคำถาม และลงมือทำสิ่งต่าง ๆ ได้รวดเร็วขึ้น และในการประชุมพนักงานล่าสุด เขาย้ำว่า Apple มีความได้เปรียบอย่างมหาศาลในสนาม AI ด้วยฐานผู้ใช้งานกว่า 2,500 ล้านอุปกรณ์ทั่วโลก และนั่นก็เป็นสัญญาณชัดเจนว่า มีความเป็นได้สูงที่ Apple จะสร้างผลิตภัณฑ์ชิ้นนี้จริง ๆ

และเมื่อ Mark Gurman สอบถามไปทาง Apple ถึงการแข่งขันในสนามอุปกรณ์สวมใส่ AI ว่าจะมาแข่งขันกับเจ้าอื่น ๆ ที่อยู่ในตลาดอย่างไร?

คำตอบคือ ทีมพัฒนาแว่นตาของ Apple เชื่อมั่นว่าผลิตภัณฑ์ของตนจะเหนือกว่า แม้ Meta จะมีประสบการณ์และพันธมิตรอย่าง Ray-Ban และ Oakley ความต่างหลักอยู่ที่ระบบนิเวศระหว่าง Siri กับ Meta AI และแนวทางฮาร์ดแวร์ Meta ใช้กล้องตัวเดียวที่สลับโหมดได้ แต่ Apple จะใช้เลนส์แยกสำหรับแต่ละฟังก์ชัน และวัสดุระดับพรีเมียมกว่า ซึ่งทั้งสองฝั่งต่างเชื่อว่าแนวทางของตนคือคำตอบที่ถูกต้อง

ติดตามเพจ Facebook: Thairath Money ได้ที่ลิงก์นี้ - https://www.facebook.com/ThairathMoney